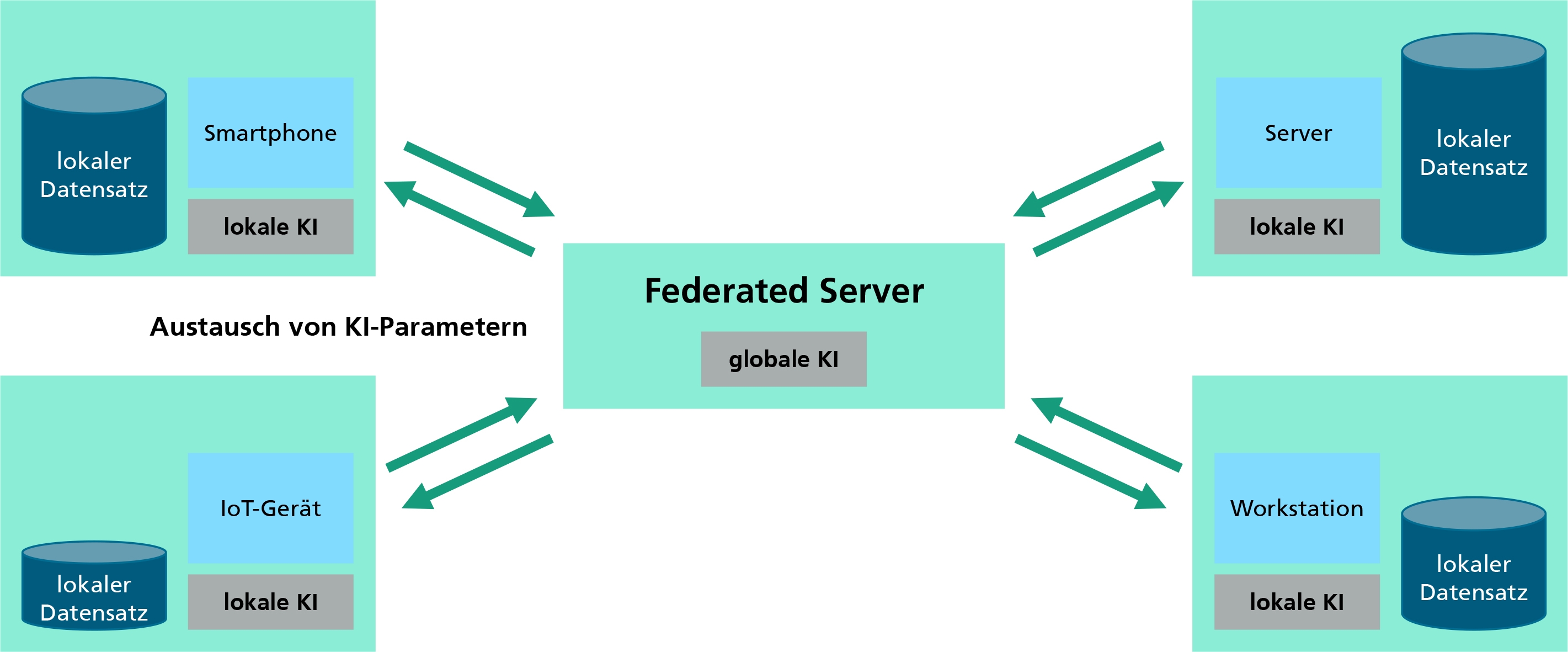

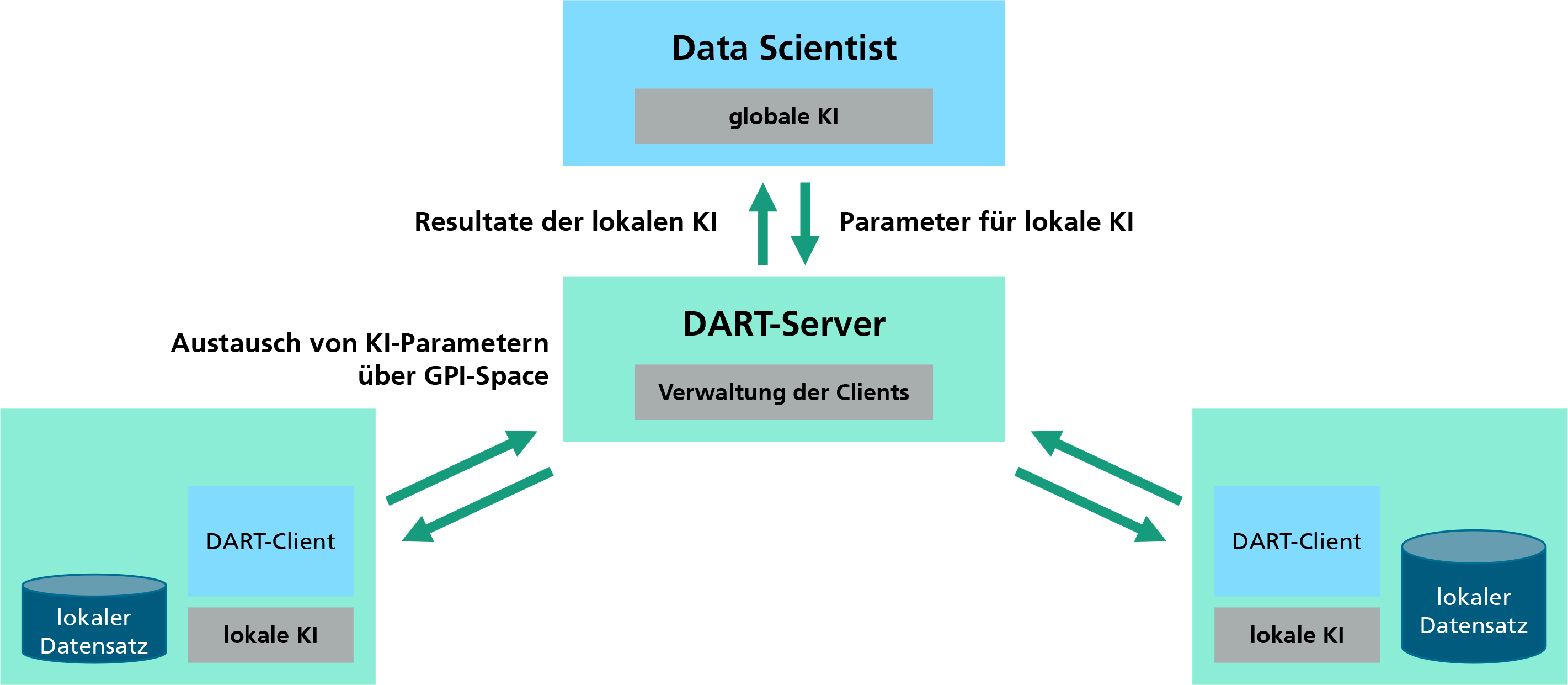

Unsere »Distributed Analytics Runtime for Federated Learning« (Fed-DART) ermöglich die einfache Umsetzung von föderierten Maschinellen Lernmethoden (ML), um lokale Daten verteilter Umgebungen zu nutzen. Damit ist es möglich ein KI-Modell zu trainieren, ohne dass die Daten zusammengeführt werden müssen.

Für das Training von KI werden immer größere Datenmengen benötigt. Je mehr Daten für das Training verfügbar sind, desto besser die Ergebnisse. In der praktischen Umsetzung von vielen KI-Projekten stellt die Beschaffung bzw. Bereitstellung dieser Daten eine erhebliche Hürde da. Die Ursachen hierfür können vielfältig sein:

- Einzelne Unternehmen bzw. Abteilungen können nur wenige Daten akquirieren oder diese nicht zentral zusammenführen.

- Regulatorische Restriktionen aufgrund von Datenhoheit und Datenschutz

- Die Daten werden auf mobilen Endgeräten generiert und können aufgrund geringer Kommunikationsbandbreite nicht zu einer großen Datenbank zusammengefasst werden. Ein Training auf allen Daten gleichzeitig ist damit nicht möglich.